Cuộc đua chip AI đang vượt ra ngoài phạm vi GPU của Nvidia. Các chip ASIC tùy chỉnh của Broadcom và sự thống trị của TSMC trong lĩnh vực sản xuất chip đang định hình lại nền kinh tế cơ sở hạ tầng AI vào năm 2026.

Trong thời gian gần hai năm qua, Nvidia đã định hình chu kỳ phần cứng trí tuệ nhân tạo. GPU của hãng trở nên đồng nghĩa với việc huấn luyện các mô hình ngôn ngữ quy mô lớn và xây dựng các cụm AI siêu quy mô.

Nhưng khi ngành công nghiệp phát triển giai đoạn đỉnh của làn sóng đầu tiên, một làn sóng thứ hai đang nổi lên rõ nét, không tập trung vào các bộ tăng tốc đa năng, mà vào silicon AI tùy chỉnh, cơ sở hạ tầng mạng và sản xuất tiên tiến. Sự chuyển dịch đó đặt hai công ty vào vị thế quyền lực bất thường là Broadcom và TSMC.

Hai công ty này không cạnh tranh trực tiếp với Nvidia. Thay vào đó, họ thu lợi từ một sự chuyển đổi rộng lớn hơn trong cách thiết kế, triển khai và mở rộng quy mô các hệ thống AI.

Khi các ông lớn trong lĩnh vực điện toán đám mây chạy đua để kiểm soát chi phí và hiệu năng, các chip tùy chỉnh đang chuyển từ các dự án thử nghiệm sang hoạt động đáp ứng các nhu cầu chiến lược trong lĩnh vực AI. Đây là nơi Broadcom và TSMC có thể thống trị.

Biểu đồ hiệu năng / chi phí ASIC vs GPU

Trên mặt trận này, những điểm chính cần ghi nhận là:

Vị thế dẫn đầu của Broadcom trong lĩnh vực ASIC: Doanh thu AI quý 1 năm 2026 dự kiến đạt 8,2 tỷ USD với lượng đơn đặt hàng tồn đọng là 73 tỷ USD, cung cấp năng lượng cho các cụm máy chủ 10GW của OpenAI thông qua các XPU tùy chỉnh được tối ưu hóa cho hiệu quả suy luận.

Vị thế độc quyền sản xuất chip của TSMC: Mở rộng năng lực sản xuất 3nm/CoWoS với vốn đầu tư 52-56 tỷ USD để thúc đẩy tăng trưởng 25-30% trong năm 2026, sản xuất hơn 90% silicon AI tiên tiến, bao gồm cả các thiết kế của đối thủ.

Nvidia chịu áp lực: ASIC tùy chỉnh làm suy yếu sự thống trị của GPU trong suy luận siêu quy mô, nhắm đến mục tiêu tiết kiệm điện năng/chi phí hơn 30% bất chấp các đối tác NVLink.

Sự chuyển hướng của các nhà cung cấp dịch vụ siêu quy mô: OpenAI, Google, Meta chuyển sang sử dụng chip tùy chỉnh trên các tiến trình của TSMC, đẩy nhanh “liên minh ASIC” cho cơ sở hạ tầng AI quy mô Stargate.

GPU so với ASIC: Tại sao silicon tùy chỉnh đang phát triển mạnh

GPU là bộ tăng tốc đa năng. Chúng vượt trội trong việc huấn luyện các mô hình AI và chạy nhiều khối lượng công việc cùng một lúc.

ASIC là các mạch tích hợp chuyên dụng hoạt động ngược lại. Các kỹ sư thiết kế chúng cho một mục đích duy nhất, chẳng hạn như suy luận LLM. Họ loại bỏ các mạch không sử dụng, tinh chỉnh đường dẫn bộ nhớ và tối ưu hóa việc di chuyển dữ liệu. Kết quả hoạt động của mạch tích hợp chuyên dụng ấn tượng là tiêu thụ điện năng thấp hơn, thông lượng cao hơn trên mỗi đô la và chi phí vận hành có thể dự đoán được.

Sự thống trị của Nvidia suy yếu trong lĩnh vực suy luận siêu quy mô

Nvidia vẫn nắm giữ 80-90% lượng chip tăng tốc được xuất xưởng hiện nay, đặc biệt là trong lĩnh vực huấn luyện.

Nhưng suy luận, công việc hàng ngày để phục vụ các mô hình đang trở thành trung tâm chú ý do chi phí chiếm ưu thế.

Các ASIC tùy chỉnh do Broadcom chế tạo nhắm trực tiếp vào phân khúc này. Bằng cách tích hợp các hoạt động của Transformer và tối ưu hóa bố cục bộ nhớ, chúng giảm mức tiêu thụ năng lượng hơn 30% trong nhiều trường hợp.

Lộ trình trung tâm dữ liệu đa gigawatt của OpenAI minh họa cho sự thay đổi này. Sự hợp tác với Broadcom nhằm mục đích triển khai các chip tối ưu hóa suy luận được xây dựng trên các tiến trình tiên tiến của TSMC bắt đầu từ cuối năm 2026.

Xu hướng này củng cố luận điểm về ASIC AI so với GPU của Nvidia: GPU vẫn là vua trong các chu kỳ phát triển, trong khi ASIC đang chiếm thị phần trong các khối lượng công việc sản xuất.

Sự trỗi dậy của ASIC của Broadcom

Doanh thu AI quý 4 năm tài chính 2025 của Broadcom đạt 6,5 tỷ USD (tăng 74% so với cùng kỳ năm ngoái), với dự báo quý 1 năm 2026 là 8,2 tỷ USD, gần một nửa tổng doanh thu trong khi lượng đơn đặt hàng tồn đọng tăng lên 73 tỷ USD.

Các quan hệ đối tác như OpenAI tích hợp trực tiếp Ethernet/PCIe, cho phép các cụm 10GW với mức tăng 30% token trên mỗi watt.

Không giống như GPU bị khóa CUDA của Nvidia, XPU của Broadcom vượt trội về tổng chi phí sở hữu (TCO) cho các tác vụ suy luận quy mô lớn, làm giảm sức mạnh định giá bất chấp các liên minh NVLink Fusion. Doanh thu năm tài chính 2026 có thể vượt mốc 80 tỷ USD, được thúc đẩy bởi các bộ tăng tốc tùy chỉnh và bộ chuyển mạch AI.

TSMC: Pháo đài sản xuất silicon

TSMC sản xuất hơn 90% chip AI tiên tiến, mở rộng công suất 3nm cho năm 2026 với vốn đầu tư 52-56 tỷ USD, tăng từ mức ước tính trước đó là 49 tỷ USD để đáp ứng cơn sốt AI.

Các nhà máy ở Arizona tăng cường sản xuất hàng loạt (HVM) trong nửa cuối năm 2027, trong khi các nút N2/N3E cung cấp năng lượng cho các thiết kế của Broadcom/OpenAI trong bối cảnh thiếu hụt CoWoS.

Quý 4 năm tài chính 2025 vượt kỳ vọng về tỷ trọng AI; tăng trưởng doanh thu năm 2026 được dự báo đạt 25-30% so với năm trước, vượt trội so với mức 10-15% của ngành. Hiệu suất điện năng của chip A16 trong nửa cuối năm 2026 hứa hẹn bước nhảy vọt 15-20%.

Dự báo doanh thu AI quý 1 năm 2026 của các công ty:

Broadcom: 8,2 tỷ USD với ASIC tùy chỉnh

TSMC: Tăng trưởng 30% với qui trình 3nm/CoWoS

Nvidia: Bị ảnh hưởng từ mối đe dọa thống trị GPU của ASIC

Sự dịch chuyển của các nhà cung cấp dịch vụ điện toán đám mây quy mô lớn định hình lại trong bối cảnh chuyển đổi sang ASIC

Chip OpenAI-Broadcom trên tiến trình 3nm của TSMC tối ưu hóa mảng xử lý song song/HBM cho LLM, nhắm mục tiêu vào cơ sở hạ tầng quy mô Stargate. Liên minh ASIC (MediaTek, Marvell) tham gia cùng Nvidia một cách chọn lọc, nhưng các chip tùy chỉnh vẫn chiếm ưu thế về suy luận.

Đến năm 2027, ASIC có thể chiếm 40% thị trường điện toán đám mây quy mô lớn, gây áp lực lên doanh thu hơn 130 tỷ USD của Nvidia.

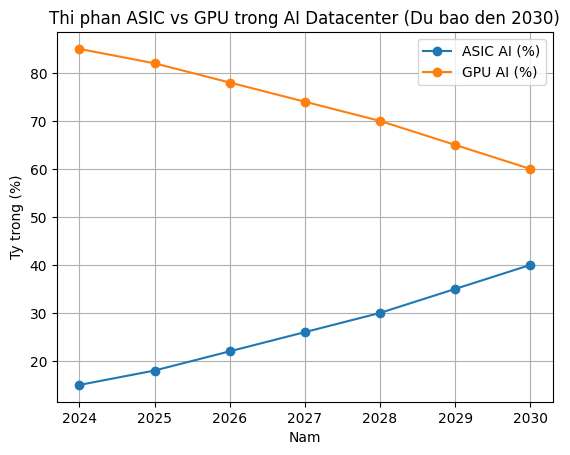

Biểu đồ thị phần GPU và ASIC đến 2030

Cơ hội của Ấn Độ trong sự chuyển đổi

Ấn Độ sẽ được hưởng lợi gián tiếp từ sự mở rộng của thị trường chip AI tùy chỉnh vào năm 2026.

Trong khi công nghệ chế tạo tiên tiến vẫn nằm ở nước ngoài, các công ty dịch vụ thiết kế, nhà cung cấp OSAT và các dự án bộ nhớ của Ấn Độ như nhà máy Gujarat của Micron và tham vọng bán dẫn của Tata có thể kết nối vào chuỗi cung ứng toàn cầu.

Khi các nhà máy điện toán đám mây đa dạng hóa hoạt động sản xuất, Ấn Độ có thể nổi lên như một trung tâm đóng gói và kỹ thuật chiến lược.

Theo nhận định của các chuyên gia công nghệ, Broadcom-TSMC không chỉ là những đối thủ cạnh tranh, họ còn là những kiến trúc sư của kỷ nguyên hiệu quả trong AI. Trong khi hệ sinh thái của Nvidia vẫn giữ vững vị thế dẫn đầu trong đào tạo, thì khối lượng công việc suy luận (hơn 80% các chu kỳ tương lai) lại ưu tiên lợi thế về tổng chi phí sở hữu (TCO) của silicon tùy chỉnh.

Các nhà cung cấp dịch vụ siêu quy mô thắng lớn về ngân sách điện năng; các nhà đầu tư nên tăng tỷ trọng đầu tư vào bộ đôi này để hưởng lợi từ tiềm năng tăng trưởng năm 2026-2027 khi CoWoS (CoA-S) được đẩy mạnh sẽ mở khóa khả năng xử lý exascale mà không gây quá tải lưới điện.

Chuỗi cung ứng bán dẫn vừa trở nên đa cực, nên Nvidia phải thích nghi hoặc chia sẻ ngôi vị dẫn đầu.

Tăng trưởng 35% của Broadcom trong lĩnh vực bán dẫn và tỷ suất lợi nhuận 59% của TSMC cho thấy tiềm năng tăng trưởng mạnh mẽ; lượng đơn đặt hàng tồn đọng 73 tỷ đô la đảm bảo doanh thu năm 2026. Nvidia thích nghi thông qua NVLink, nhưng bộ đôi Broadcom/TSMC đang thúc đẩy thị trường lưỡng cực.

Bộ ba này thúc đẩy sự phát triển mạnh mẽ của AI-silicon tùy chỉnh, mở ra khả năng xử lý exascale mà không làm gián đoạn lưới điện.

Cuộc đua chip AI đang phát triển vượt ra ngoài phạm vi GPU của Nvidia, hướng tới sự bùng nổ của các chip silicon tùy chỉnh do Broadcom và TSMC sản xuất. Khi năm 2026 đang diễn tiến với chi phí đầu tư và triển khai kỷ lục, hiệu quả sẽ vượt trội hơn so với số phép tính đơn thuần, mở ra khả năng xử lý hàng nghìn tỷ tham số ở quy mô bền vững.

Bảo San